经典RNN梳理

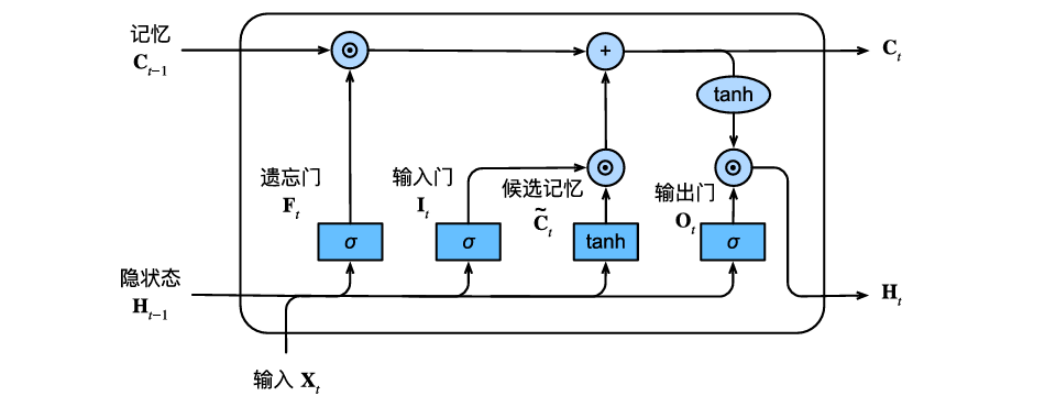

一、前言 学习RNN开始真的尤其不好理解时间步、数据格式等等,因为传统的BP和CNN可以根据图直观理解,比如下面的BP 或者CNN中的卷积层,池化层,全连接层可以用图绘制出来再空间上理解,一层层的叠加,在写代码的时候就按照图搭积木一样,但是RNN因为是序列展开,所以开始有点难理解,输入数据也变的难以理解,但RNN这块的数据都如下图: 二、普通RNN:2.1 网络结构: 关键理解按照时间这种序列的形式展开,MLP还是原来的MLP只不过给他按照时间展开就成为一个循环,也就是隐状态不断地循环更新,所以也叫循环神经网络 pytorch中RNN模块的输出,output是h_t,每个时刻的容器装在一起,而h_n 是最后一个时刻state,这里跟李沐老师从零开始实现RNN中的output不一样,因为是自己实现的,所以那里的output是真输出的容器,即y = relu(h * w_hq + b_q)的容器,所以使用nn.RNN时需要自己添加一个输出层 而且如果是多层的隐藏层,output里面装的只是最上面一层的ht。 三、GRU:3.1 门...

经典CNN梳理

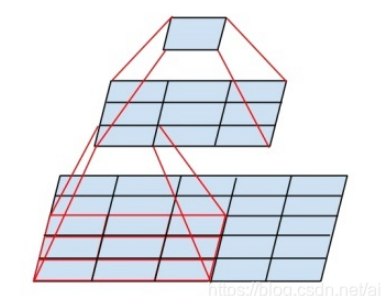

一、前置基础:深度学习这块,改来改去就是数据和model在改,数据进行一些处理后放进原模型中效果更好则就是idea,或者数据不动,改动模型的一些小结构效果更好又是一个idea,从cifar10分类任务引入卷积神经网络,首先回顾一下卷积神经网络中一些基础的概念。 1.1 感受野:指在输入图像上,某层的一个神经元能看到或相应区域大小,换句话说就是在网络最初输入上看到的像素大小。 1.2 作用:感受野越大,在输入层上看到的区域就越大,可以捕捉到更多的全局特征,也就进而会影响到卷积层或者整个网络的设计架构。 1.3 卷积层(Convolutional Layer):卷积到底起到什么作用:卷积操作就是用一个可移动的小窗口来提取图像中的特征,这个操作可以捕捉到图像中的局部特征而不受其位置的影响 但更清楚的说明是理解为用一个更小的窗口(特征),或者说我我们需要的结果这个作为过滤器,挨个滑动去匹配,滑动的每个位置都会计算出一个值,最终匹配程度最高的地方计算出的置同样也会最高,这样也就提取出特征了,而不会受到位置的影响 所以,我觉得就能理解为什么卷积核的英文名是filter,过滤器;再举个我觉得比...

pytorch框架学习笔记

对于pytorch这种框架的学习,初学时不要死扣原理!!!要先会用,回过头来结合深度学习理论再弄懂框架封装的算子/方法的作用 一、Tensorboard作用:可视化工具 1.1导入方式12import torch.utils.tensorboardfrom torch.utils.tensorboard import SummaryWriter # 用来输出 1.2 logs文件打开方式1tensorboard --logdir=事件文件名 --port=6007(指定端口) 1.3 安装OpenCV2(超级快)12#安装opencv指令pip install -i https://pypi.tuna.tsinghua.edu.cn/simple --trusted-host pypi.tuna.tsinghua.edu.cn opencv-python 1.4 SummaryWriter输出12writer = SummaryWriter("logs") # 创建logs,输出的日志文件文件夹writer.add_image(tag, tensor, st...

conda常用命令

1. 环境管理1234567891011# 创建并激活环境conda create -n py_stu python=3.9 # -n 后是环境名称conda activate py_stu # 激活py_stu这个环境conda deactivate # 退回到base# 删除环境conda env remove -n py_stu# 查看已有环境conda info -econda env list 2. 环境信息123456789101112131415161718192021# 查看 conda 版本conda --version# 查看 Python 版本(当前环境)python --version# 查看 conda 配置信息conda info# 设置国内镜像源(加速下载,以清华源为例)conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/free/conda config --add channels https://mirrors.tuna.tsingh...